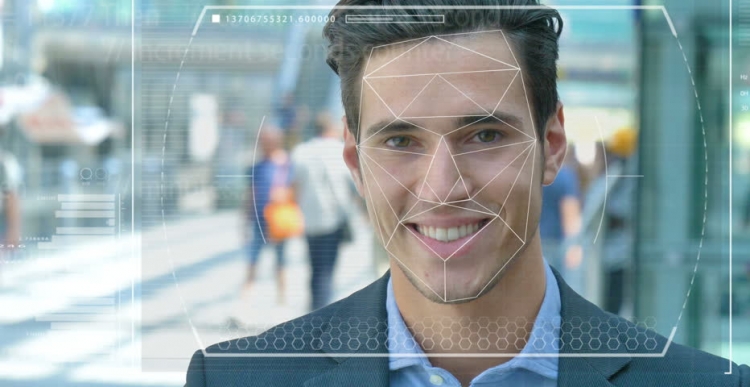

Dünyanın dört bir yanındaki polis ve güvenlik güçleri, suçluları ve teröristleri tanımlamak için bir araç olarak kullanmak üzere otomatik yüz tanıma sistemlerini test ediyor. Fakat bu teknoloji ne kadar kesin ve ne kadar kolay ve yapay zeka (AI), temelde çalıştığı zulüm ve baskı araçlarına dönüşüyor mu?

Sistem özellikleri

Şüpheli bir teröristin yoğun nüfuslu bir şehir merkezine intihar görevi gönderdiğini hayal edin. Bir bomba düşürürse, yüzlerce insan ölebilir veya ciddi şekilde yaralanabilir. Video gözetimi kullanarak kalabalıktaki yüzleri tarama prosedürü, bir saldırganı tanımlamanıza ve özelliklerini, ünlü teröristlerin veya “ilgilenen kişilerin” bir veritabanındaki güvenlik hizmetleriyle otomatik olarak fotoğraflarla karşılaştırmasını sağlar.

Tesadüf durumunda, sistem alarmı yükseltir ve hızlı tepki veren terörle mücadele güçleri, patlayıcıyı harekete geçirmeden önce şüpheliyi "etkisiz hale getirdikleri" yere gönderilir. Modern teknoloji sayesinde yüzlerce hayat kurtarıldı.

İşyerinde olası sorunlar

Ancak, yüz tanıma (FR) teknolojisi düzgün çalışmıyorsa? Terörist değil, sadece şanssız olan ve saldırgan gibi davrandığı sıradan bir insan olduğu ortaya çıktı. Masum bir yaşam, uzmanlar da hatalı bir sisteme inandığı için basit bir şekilde imha edilebilirdi. Ama ya böyle bir insan olursanız?

Bu, yüz tanıma sistemi ve yapay zekanın karşılaştığı etik ikilemlerden sadece bir tanesidir. Nesneleri ve yüzleri “görmeleri”, tanımaları ve ayırt etmeleri için makineleri eğitmek gerçekten zor. Araştırmacılar, çok uzun zaman önce değil, bazen de denildiği gibi, bilgisayarlı görmeyi kullanarak, bu teknolojinin etkinliğini belirlemek için bir tür litmus testi haline gelen kuru üzümlü çörekler ve bir chihuahua arasındaki farkı belirlemeye çalıştı.

Yüz tanıma zorlukları

Bilgisayar Teknolojileri, Massachusetts Institute of Technology'de (ve aynı zamanda Algoritmik Adalet Birliği'nin kurucusu) laboratuvarı temsil eden Joy Buolamvini ve Google ekibinin yapay zeka ile ilgili etik konulardaki teknik direktörü Timnit Gebru'nun yüz tanıma sisteminin zor olduğunu gösterdi Derileri yeterince karanlıksa, kadın ve erkekleri ayırt eder. Sistem genellikle kadınları koyu tenli erkekler için yanlış anladı.

“Yaklaşık 130 milyon yetişkin Amerikalı zaten yüz tanıma veritabanları üzerinde,” dedi Cenevre'deki AI Zirvesi için Mayıs ayında Dr. Gebru. “Fakat orijinal veri setleri çoğunlukla aralarında çok fazla erkek olan beyaz ırkın temsilcilerinden oluşuyor.” Bu nedenle, daha koyu cilt tipine sahip insanları tanırken, cilt tipine ve cinsiyetine bağlı olarak hala büyük miktarda hata vardır.

Teknoloji kullanımı

Kaliforniya şehri San Francisco kısa süre önce ulaştırma ve kolluk kuvvetlerinin sivil özgürlüklere yönelik kusurlarını ve tehditlerini tanımalarında yüz tanıma kullanımını yasakladı. Ancak Amerika Birleşik Devletleri'ndeki ve dünyanın diğer ülkelerindeki diğer şehirler bu teknolojiyi deneyimlemeye devam ediyor.

Örneğin, İngiltere'de, Güney Galler, Londra, Manchester ve Leicester'deki polis kuvvetleri, bu sistem çalışırken, Liberty ve Big Brother Watch gibi sivil özgürlük örgütlerini, sistem çalışırken meydana gelen yanlış eşleşme sayısından endişe duyanları korkutuyor.

Hatalar ve Korkular

Uygulamada bu, masum insanların yanlışlıkla potansiyel suçlu olarak adlandırıldığı anlamına gelir. Gebru’ya göre, bu tür sorunlar kesinlikle herkes için endişelenmeli, bu tür önleyici ve öngörücü tedbirlerin kullanımı yüksek oranlar içeriyor.

ABD'li nüfusun sadece% 13'ünü oluşturdukları gerçeğine rağmen, siyah Amerikalıların ABD'deki bütün hapishane mahkumlarının% 37,5'ini (Federal Cezaevleri Bürosu'na göre) oluşturduğu göz önüne alındığında, şu anda mevcut veri kümelerini kullanan kötü yazılı algoritmalar tahmin edilebilir. bu siyah insanların bir suç işlemesinin daha muhtemel olduğu. Bunun polis ve sosyal politikalar için ne anlama geldiğini anlamak için dahi olmaya gerek yok.

Daha yakın zamanlarda, Essex Üniversitesi'nden bilim adamları, Londra polisinde yapılan yargılamalarda kullanılan tesadüflerin% 80 oranında yanlış olduğu sonucuna varmış, bu da potansiyel olarak ciddi adalet ihlallerine ve vatandaşların mahremiyet haklarının ihlal edilmesine yol açabilir.

Bir Britanyalı Ed Bridges, Güney Galler polisi tarafından yüz tanıma teknolojisinin kullanımıyla ilgili bir dava başlattı. alışveriş yaparken fotoğrafı çekildi ve İngiliz Bilgi Komiseri Elizabeth Denham, tanıma teknolojisinin kullanımını düzenleyen yasal bir çerçevenin olmayışından duyduğu endişeyi dile getirdi.

Ancak bu tür korkular, teknoloji devi Amazon'un Rekognition FR aracını ABD polis gücüne satmasını, hala hiçbir şeye yol açmayan hissedarların tereddütlü bir isyanına rağmen durdurmadı.

umutları

Amazon, müşterilerin teknolojisini nasıl kullandıklarından sorumlu olmadığını söylüyor. Ancak bu ilişkiyi, Einstein Vision adlı kendi görüntü tanıma aracını geliştiren müşteri ilişkileri yönetimi için bir teknoloji olan Salesforce ile karşılaştırın.

BBC'nin etik bir yapay zeka uzmanı olan BBC Salesforce, “Yüz tanıma teknolojisi, bir hapishanede mahkumları izlemek veya çete şiddetini önlemek için uygun olabilir” dedi. Ancak polis insanları tutuklarken kameralarla birlikte kullanmak istediğinde, şirket bunu uygunsuz buldu. Aynı zamanda, AI'nın belirli senaryolarda hiç kullanılıp kullanılmayacağı sorulmalı ve örneklerden biri yüz tanımadır.

Günümüzde, teknoloji sağlayıcıları, yazılımlarının yalnızca potansiyel düşmanları tanımlamakla kalmayıp aynı zamanda şüpheli davranışları da tanıyabildiğini iddia ettiği için bu teknoloji ordu tarafından da kullanılmaktadır.