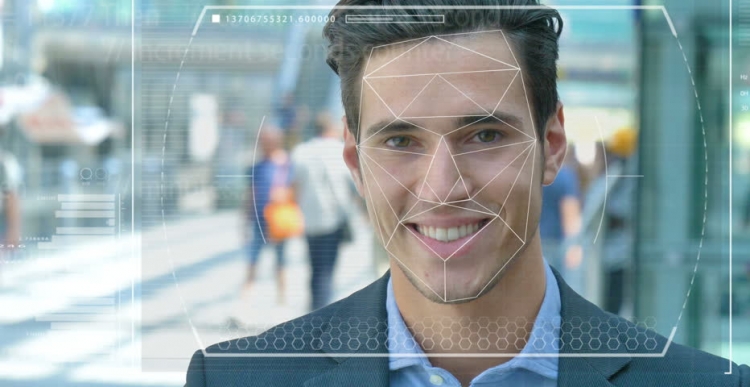

Policija un drošības spēki visā pasaulē testē automatizētas sejas atpazīšanas sistēmas, lai tās izmantotu kā instrumentu noziedznieku un teroristu identificēšanai. Bet cik precīza ir šī tehnoloģija un cik vienkārša tā ir, un mākslīgais intelekts (AI), uz kura pamata tā darbojas, kļūst par vajāšanas un apspiešanas instrumentiem?

Sistēmas funkcijas

Iedomājieties, ka aizdomās par teroristu tiek nosūtīts pašnāvības misijā uz blīvi apdzīvotu pilsētas centru. Ja viņš nomet bumbu, simtiem cilvēku var nomirt vai tikt nopietni ievainoti. Procedūra seju skenēšanai pūlī, izmantojot videonovērošanu, ļauj identificēt uzbrucēju un automātiski salīdzina viņa raksturlielumus ar fotogrāfijām slavenu teroristu vai “interešu personu” datu bāzē ar drošības dienestiem.

Sakritības gadījumā sistēma izsauc trauksmi, un ātrās reaģēšanas pretterorisma spēki tiek nosūtīti uz vietu, kur viņi "neitralizē" aizdomās turamo, pirms viņš var aktivizēt sprāgstvielas. Pateicoties mūsdienu tehnoloģijām, tika izglābtas simtiem cilvēku dzīvības.

Iespējamās problēmas darbā

Bet kā būtu, ja sejas atpazīšanas (FR) tehnoloģija nedarbotos pareizi? Un izrādījās, ka tas nav terorists, bet gan parasts cilvēks, kuram vienkārši paveicās, un viņš izrādījās kā uzbrucējs. Nevainīga dzīve būtu vienkārši iznīcināta, jo arī eksperti ticēja kļūdainai sistēmai. Bet ko tad, ja izrādīsies, ka esi tāds cilvēks?

Šī ir tikai viena no ētiskajām dilemmām, ar kuru saskaras sejas atpazīšanas sistēma un mākslīgais intelekts. Ir patiešām grūti apmācīt mašīnas “redzēt”, atpazīt un atšķirt objektus un sejas. Izmantojot datoru redzi, kā to dažreiz sauc, ne tik sen, pētnieki mēģināja noteikt atšķirību starp bulciņām ar rozīnēm un čivavu, kas kļuva par sava veida lakmusa pārbaudi šīs tehnoloģijas efektivitātes noteikšanai.

Sejas atpazīšanas grūtības

Datorzinātnieki Džoijs Buolamvini, kurš pārstāv Masačūsetsas Tehnoloģiju institūta laboratoriju (un vienlaikus Algorithmic Justice League dibinātāju), un Timnit Gebru, Google komandas tehniskais līdzdirektors ar mākslīgo intelektu saistītos ētiskos jautājumos, parādīja, ka sejas atpazīšanas sistēma ir sarežģīta. atšķir vīriešus un sievietes, ja viņu āda ir pietiekami tumša. Sistēma diezgan bieži nepareizi iezīmē sievietes ar tumšu ādu vīriešiem.

“Aptuveni 130 miljoni pieaugušu amerikāņu jau ir sejas atpazīšanas datu bāzēs,” sacīja Dr. Gebru maijā maijā AI for Good sammitā Ženēvā. "Bet sākotnējās datu kopās galvenokārt ir baltās rases pārstāvji, starp kuriem ir daudz vairāk vīriešu." Tāpēc, atpazīstot cilvēkus ar tumšāku ādas tipu, joprojām ir milzīgs kļūdu procents ādas tipa un dzimuma dēļ.

Tehnoloģiju izmantošana

Kalifornijas pilsētā Sanfrancisko nesen tika aizliegts izmantot sejas atpazīšanu transporta un tiesībaizsardzības aģentūrās, atzīstot tās nepilnības un draudus pilsoņu brīvībām. Bet citas Amerikas Savienoto Valstu pilsētas un citas pasaules valstis turpina pieredzēt šo tehnoloģiju.

Piemēram, Apvienotajā Karalistē policijas spēki Dienvidvelsā, Londonā, Mančesterā un Lesterē testē šo tehnoloģiju, kas biedē tādas pilsonisko brīvību organizācijas kā Liberty un Big Brother Watch, kuras ir nobažījušās par viltus maču skaitu, kas notiek sistēmas darbības laikā.

Kļūdas un bailes

Praksē tas nozīmē, ka nevainīgus cilvēkus kļūdaini sauc par iespējamiem noziedzniekiem. Pēc dr. Gebru domām, šādām problēmām noteikti vajadzētu satraukt ikvienu, šādu profilaktisko un prognozējošo pasākumu izmantošana ir saistīta ar lielām likmēm.

Ņemot vērā, ka melnādainie amerikāņi veido 37,5% no visiem ieslodzītajiem Amerikas Savienotajās Valstīs (saskaņā ar Federālā cietumu biroja datiem), neskatoties uz to, ka viņi veido tikai 13% no ASV iedzīvotājiem, slikti uzrakstīti algoritmi, kas izmanto pašreiz pieejamās datu kopas, var paredzēt ka melnādainie cilvēki biežāk izdara noziegumu. Jums nav jābūt ģēnijam, lai saprastu, ko tas var nozīmēt policijai un sociālajai politikai.

Pavisam nesen Eseksas universitātes zinātnieki secināja, ka sakritības, kas tika izmantotas izmēģinājumos Londonas policijā, bija 80% nepareizas, kas potenciāli varētu izraisīt nopietnus taisnīguma pārkāpumus un pilsoņu tiesību uz privātumu pārkāpumus.

Viens brits Eds Bridžs pēc tiesas procesa uzsāka tiesas procesu par sejas atpazīšanas tehnoloģijas izmantošanu Dienvidvelsas policijā viņa fotogrāfija tika uzņemta, iepērkoties, un Lielbritānijas informācijas komisāre Elizabete Denhema pauda bažas par tiesiskā regulējuma trūkumu, kas regulētu atpazīšanas tehnoloģijas izmantošanu.

Bet šādas bailes neapturēja tehnoloģiju gigantu Amazon pārdot savu rīku Rekognition FR ASV policijas spēkiem, neskatoties uz akcionāru vilcinošajiem nemieriem, kas joprojām noveda pie neko.

Perspektīvas

Amazon saka, ka tā nav atbildīga par to, kā klienti izmanto tās tehnoloģiju. Bet salīdziniet šīs attiecības ar Salesforce - klientu attiecību pārvaldības tehnoloģiju, kas ir izstrādājusi savu attēlu atpazīšanas rīku ar nosaukumu Einstein Vision.

"Sejas atpazīšanas tehnoloģija var būt piemērota cietumā, lai izsekotu ieslodzītos vai novērstu bandu vardarbību," sacīja BBC ētiskā mākslīgā intelekta eksperts BBC Salesforce. Bet, kad policisti, aizturot cilvēkus, vēlējās to izmantot kopā ar kamerām, uzņēmums to atzina par nepiemērotu. Šajā gadījumā būtu jājautā, vai noteiktos scenārijos vispār ir nepieciešams izmantot AI, un viens no piemēriem ir sejas atpazīšana.

Pašlaik šo tehnoloģiju izmanto arī militārpersonas, jo tehnoloģiju nodrošinātāji apgalvo, ka viņu programmatūra var ne tikai identificēt potenciālos ienaidniekus, bet arī atpazīt aizdomīgu rīcību.