Policija i sigurnosne snage širom svijeta testiraju automatizirane sustave za prepoznavanje lica kako bi ih koristili kao alat za identifikaciju kriminalaca i terorista. No koliko je tačna ta tehnologija i koliko lako i umjetna inteligencija (AI), na temelju koje funkcionira, postaju oruđe progona i ugnjetavanja?

Značajke sustava

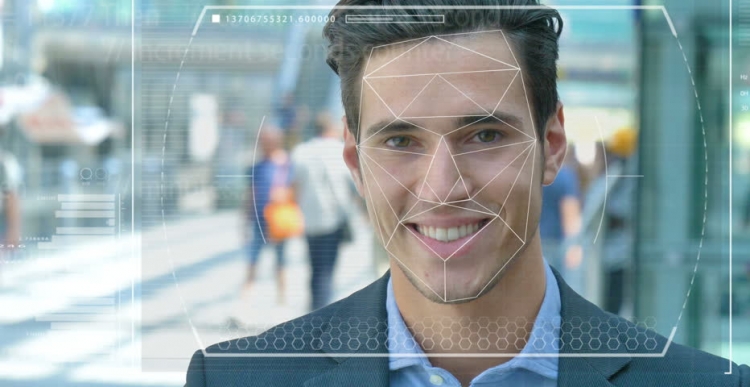

Zamislite da je osumnjičeni terorist poslan na samoubilačku misiju u gusto naseljeno gradsko središte. Ako baci bombu, stotine ljudi mogu umrijeti ili biti ozbiljno ozlijeđene. Postupak skeniranja lica u gomili pomoću video nadzora omogućava vam da identificirate napadača i automatski uspoređuje njegove karakteristike sa fotografijama u bazi poznatih terorista ili "osoba od interesa" sigurnosnim službama.

U slučaju slučajnosti, sustav podiže alarm, a antiterorističke snage brze reakcije šalju se na mjesto gdje "neutraliziraju" osumnjičenog prije nego što on može aktivirati eksploziv. Stotine života spasilo se zahvaljujući modernoj tehnologiji.

Mogući problemi na poslu

Ali što ako tehnologija prepoznavanja lica (FR) ne radi ispravno? A pokazalo se da nije terorist, već obična osoba koja samo nije bila sretna i pokazalo se da je poput napadača. Nevin život bio bi jednostavno uništen jer su i stručnjaci vjerovali u pogrešan sustav. Ali što ako se ispostavi da ste takva osoba?

Ovo je samo jedna od etičkih dilema koja se suočava sa sustavom prepoznavanja lica i umjetnom inteligencijom. Stvarno je teško trenirati strojeve da “vide”, prepoznaju i razlikuju predmete i lica. Koristeći računalni vid, kako se ponekad naziva, ne tako davno, istraživači su pokušali utvrditi razliku između peciva sa grožđicama i čihuuahua, što je postalo svojevrsni lakmusov test za utvrđivanje učinkovitosti ove tehnologije.

Poteškoće s prepoznavanjem lica

Računalni tehnolozi, Joy Buolamvini, koji predstavlja laboratorij na Massachusetts Institute of Technology (i istovremeno osnivač Algorithmic Justice League), i Timnit Gebru, tehnički ravnatelj Googleovog tima za etička pitanja koja se odnose na umjetnu inteligenciju, pokazali su da je sustav prepoznavanja lica težak razlikuje muškarce i žene ako im je koža dovoljno tamna. Sustav je često pogrešno shvaćao žene s tamnom kožom za muškarce.

"Oko 130 milijuna odraslih Amerikanaca već je na bazama podataka o prepoznavanju lica", rekao je dr. Gebru u svibnju na sastanku AI za dobar samit u Ženevi. "Ali izvorni setovi podataka sadrže uglavnom predstavnike bijele rase, među kojima ima mnogo više muškaraca." Stoga, prilikom prepoznavanja ljudi tamnijeg tipa kože, još uvijek postoji ogroman postotak pogrešaka zbog tipa kože i spola.

Korištenje tehnologije

Kalifornijski grad San Francisco nedavno je zabranio uporabu prepoznavanja lica od strane prijevoznih i agencija za provođenje zakona radi prepoznavanja njegovih nesavršenosti i prijetnji građanskim slobodama. No, drugi gradovi u Sjedinjenim Državama i drugim zemljama svijeta i dalje doživljavaju ovu tehnologiju.

Na primjer, u Velikoj Britaniji, policijske snage u Južnom Walesu, Londonu, Manchesteru i Leicesteru testiraju ovu tehnologiju, koja užasne organizacije za građanske slobode, poput Libertyja i Big Brother Watch-a, koje su zabrinute zbog broja lažnih podudarnosti do kojih dolazi kada sustav radi.

Pogreške i strahovi

U praksi to znači da nevine ljude pogrešno nazivaju potencijalnim zločincima. Prema dr. Gebru, takvi bi problemi zasigurno trebali izazvati zabrinutost za sve, uporaba takvih preventivnih i prediktivnih mjera uključuje visoke stope.

S obzirom na to da crnački Amerikanci čine 37,5% svih zatvorenika u Sjedinjenim Državama (prema Federalnom zavodu za zatvore), unatoč činjenici da čine samo 13% stanovništva SAD-a, loše napisani algoritmi koji koriste trenutno dostupne skupove podataka mogu predvidjeti da su crnci vjerojatniji da će počiniti zločin. Ne trebate biti genij da biste shvatili što to može značiti za policiju i socijalnu politiku.

U novije vrijeme, znanstvenici sa Sveučilišta u Essexu došli su do zaključka da su slučajnosti korištene u pokusima londonske policije pogrešne 80%, što bi potencijalno moglo dovesti do ozbiljnih kršenja pravde i kršenja prava građana na privatnost.

Jedan Britanac, Ed Bridges, započeo je parnicu zbog korištenja tehnologije prepoznavanja lica od strane policije Južnog Walesa njegova je fotografija snimljena dok je bio u kupovini, a britanska povjerenica za informacije Elizabeth Denham izrazila je zabrinutost zbog nedostatka pravnog okvira koji bi upravljao uporabom tehnologije prepoznavanja.

Ali takvi strahovi nisu spriječili tehnološkog diva Amazon da proda svoj alat Rekogmuncija FR američkim policijskim snagama, usprkos neodlučnom neredu dioničara koji još uvijek nije doveo do ničega.

planovi

Amazon kaže kako nije odgovoran za to kako kupci koriste njegovu tehnologiju. Ali usporedite taj odnos s Salesforceom, tehnologijom za upravljanje odnosima s kupcima, koja je razvila vlastiti alat za prepoznavanje slike pod nazivom Einstein Vision.

„Tehnologija prepoznavanja lica možda bi bila prikladna u zatvoru za praćenje zatvorenika ili za sprečavanje nasilja u bandi“, rekao je BBC Salesforce, stručnjak za etičku umjetnu inteligenciju na BBC-u. Ali kada ga je policija htjela upotrijebiti zajedno s kamerama prilikom uhićenja ljudi, tvrtka je to smatrala neprimjerenim. U ovom slučaju trebalo bi se zapitati je li uopće potrebno koristiti AI u određenim scenarijima, a jedan od primjera je prepoznavanje lica.

Trenutno ovu tehnologiju koristi i vojska, jer pružatelji tehnologije tvrde da njihov softver ne može samo identificirati potencijalne neprijatelje, već i prepoznati sumnjivo ponašanje.