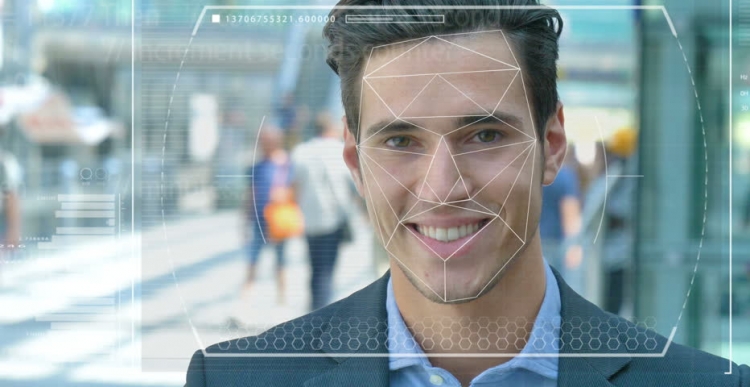

Ang mga pulis at security pwersa sa buong mundo ay sumusubok sa mga awtomatikong sistema ng pagkilala sa mukha upang magamit ang mga ito bilang isang tool upang makilala ang mga kriminal at terorista. Ngunit gaano tumpak ang teknolohiyang ito at kung gaano kadali at ang artipisyal na intelihente (AI), batay sa kung saan ito gumana, ay naging mga tool ng pag-uusig at pang-aapi?

Mga tampok ng system

Isipin na ang isang pinaghihinalaang terorista ay ipinadala sa isang misyon ng pagpapakamatay sa isang makapal na populasyon na sentro ng lungsod. Kung bumagsak siya ng bomba, daan-daang tao ang maaaring mamatay o malubhang nasugatan. Ang pamamaraan para sa pag-scan ng mga mukha sa isang karamihan ng tao gamit ang pagsubaybay sa video ay nagbibigay-daan sa iyo upang makilala ang isang umaatake at awtomatikong ikinukumpara ang kanyang mga katangian sa mga litrato sa isang database ng mga kilalang terorista o "mga taong interes" sa mga serbisyong pangseguridad.

Sa kaso ng pagkakaisa, pinalaki ng system ang alarma, at ang mga anti-teroristang pwersa ng mabilis na reaksyon ay ipinadala sa lugar kung saan "pinapagaan nila" ang suspect bago niya maisaaktibo ang mga eksplosibo. Daan-daang buhay ang na-save salamat sa modernong teknolohiya.

Posibleng mga problema sa trabaho

Ngunit paano kung ang teknolohiya ng pagkilala sa mukha (FR) ay hindi gumana nang tama? At ito ay hindi isang terorista, ngunit isang ordinaryong tao na sadyang hindi sinasadya at siya ay naging tulad ng isang umaatake. Ang isang inosenteng buhay ay masisira lamang dahil ang mga eksperto ay naniniwala rin sa isang maling sistema. Ngunit paano kung ikaw ay maging tulad ng isang tao?

Ito ay isa lamang sa mga etikal na dilemmas na kumokonekta sa sistema ng pagkilala sa mukha at artipisyal na katalinuhan. Mahirap talagang sanayin ang mga makina upang "makita", makilala at makilala ang mga bagay at mukha. Gamit ang paningin ng computer, tulad ng kung minsan ay tinawag na, hindi pa matagal na, sinubukan ng mga mananaliksik na malaman ang pagkakaiba sa pagitan ng mga buns na may mga pasas at isang chihuahua, na naging isang uri ng pagsubok sa litmus para sa pagtukoy ng pagiging epektibo ng teknolohiyang ito.

Mga paghihirap sa pagkilala sa mukha

Ang mga teknolohiyang kompyuter, si Joy Buolamvini, na kumakatawan sa laboratoryo sa Massachusetts Institute of Technology (at kasabay nito ang tagapagtatag ng Algorithmic Justice League), at Timnit Gebru, teknikal na co-director ng koponan ng Google tungkol sa mga isyung etikal na may kaugnayan sa artipisyal na intelektwal, ay nagpakita na mahirap ang sistema ng pagkilala sa facial nakikilala sa pagitan ng mga kalalakihan at kababaihan kung madilim ang kanilang balat. Ang system ay madalas na nagkakamali sa mga kababaihan na may madilim na balat para sa mga kalalakihan.

"Halos 130 milyong may sapat na gulang na Amerikano ay nasa mga database ng pagkilala sa mukha," sabi ni Dr. Gebru noong Mayo sa AI para sa Magandang Summit sa Geneva. "Ngunit ang mga orihinal na set ng data ay naglalaman ng karamihan sa mga kinatawan ng puting lahi, na kasama sa mga lalaki." Samakatuwid, kapag nakikilala ang mga tao na may isang mas madidilim na uri ng balat, mayroon pa ring isang malaking porsyento ng mga error dahil sa uri ng balat at kasarian.

Paggamit ng teknolohiya

Kamakailan lamang ay ipinagbawal ng lungsod ng California ng San Francisco ang paggamit ng pagkilala sa mukha ng mga ahensya ng transportasyon at pagpapatupad ng batas bilang pagkilala sa mga kahinaan nito at pagbabanta sa kalayaan sa sibil. Ngunit ang iba pang mga lungsod sa Estados Unidos at iba pang mga bansa sa mundo ay patuloy na nakakaranas ng teknolohiyang ito.

Sa UK, halimbawa, ang mga puwersa ng pulisya sa South Wales, London, Manchester at Leicester ay sumusubok sa teknolohiyang ito, na sinisindak ang mga organisasyong kalayaan sa sibil tulad ng Liberty at Big Brother Watch, na nababahala tungkol sa bilang ng mga maling tugma na nagaganap sa panahon ng pagpapatakbo ng system.

Mga pagkakamali at Takot

Sa pagsasagawa, nangangahulugan ito na ang mga inosenteng tao ay nagkakamali na tinawag na mga potensyal na kriminal. Ayon kay Dr. Gebru, ang gayong mga problema ay dapat na tiyak na magdulot ng pag-aalala sa lahat, ang paggamit ng nasabing pag-iwas at mapaghulaang mga hakbang ay nagsasangkot ng mataas na rate.

Ibinigay na ang mga itim na Amerikano ay bumubuo ng 37.5% ng lahat ng mga bilanggo sa bilangguan sa Estados Unidos (ayon sa Federal Bureau of Prisons), sa kabila ng katotohanan na bumubuo lamang sila ng 13% ng populasyon ng US, hindi maganda ang nakasulat na mga algorithm gamit ang kasalukuyang magagamit na mga database na ang mga itim na tao ay mas malamang na gumawa ng isang krimen. Hindi mo kailangang maging isang henyo upang maunawaan kung ano ang ibig sabihin nito para sa mga patakaran ng pulisya at panlipunan.

Karamihan sa mga kamakailan-lamang, ang mga siyentipiko mula sa University of Essex ay natapos na ang mga coincidences na ginamit sa mga pagsubok sa pulisya ng London ay 80% mali, na maaaring humantong sa malubhang paglabag sa hustisya at paglabag sa karapatan ng mga mamamayan sa privacy.

Ang isang Briton, Ed Bridges, ay nagsimula ng isang demanda sa paggamit ng teknolohiya ng pagkilala sa mukha ng pulisya ng South Wales pagkatapos ang kanyang litrato ay nakuha habang siya ay namimili, at ang Komisyoner ng Britain para sa Impormasyon na si Elizabeth Denham ay nagpahayag ng pag-aalala tungkol sa kakulangan ng isang ligal na balangkas na namamahala sa paggamit ng teknolohiya ng pagkilala.

Ngunit ang naturang takot ay hindi tumigil sa tech na higanteng Amazon mula sa pagbebenta ng tool na Rekognition FR nito sa puwersa ng pulisya ng Estados Unidos, sa kabila ng isang nag-aalangan na kaguluhan ng mga shareholders na humantong pa sa wala.

Mga prospect

Sinasabi ng Amazon na hindi responsable para sa kung paano ginagamit ang mga customer sa teknolohiya. Ngunit ihambing ang kaugnayan na ito sa Salesforce, isang teknolohiya para sa pamamahala ng ugnayan ng customer, na binuo ng sariling kasangkapan sa pagkilala sa imahe na tinatawag na Einstein Vision.

"Ang teknolohiya ng pagkilala sa mukha ay maaaring angkop sa isang bilangguan upang subaybayan ang mga bilanggo o maiwasan ang karahasan sa gang," sabi ni BBC Salesforce, isang etikal na artipisyal na intelihente ng intelihente sa BBC. Ngunit kapag nais ng pulisya na gamitin ito kasama ng mga camera kapag inaresto ang mga tao, natagpuan ng hindi naaangkop ang kumpanya. Sa kasong ito, dapat tanungin ng isa kung kinakailangan na gamitin ang AI sa pangkalahatan sa ilang mga sitwasyon, at ang isa sa mga halimbawa ay ang pagkilala sa mukha.

Sa kasalukuyan, ang teknolohiyang ito ay ginagamit din ng militar, dahil inaangkin ng mga nagbibigay ng teknolohiya na ang kanilang software ay hindi lamang makikilala ang mga potensyal na kaaway, ngunit kinikilala din ang kahina-hinalang pag-uugali.