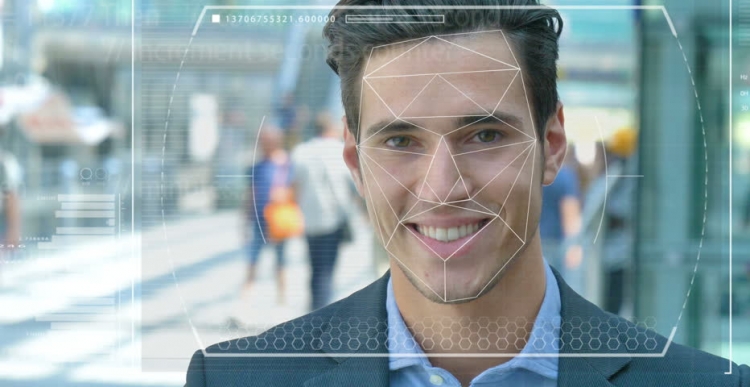

ตำรวจและกองกำลังรักษาความปลอดภัยทั่วโลกกำลังทดสอบระบบจดจำใบหน้าอัตโนมัติเพื่อใช้เป็นเครื่องมือในการระบุอาชญากรและผู้ก่อการร้าย แต่เทคโนโลยีนี้มีความแม่นยำเพียงใดและมีความง่ายดายเพียงใดและปัญญาประดิษฐ์ (AI) บนพื้นฐานของการทำงานเป็นเครื่องมือในการประหัตประหารและการกดขี่?

คุณสมบัติของระบบ

ลองนึกภาพว่าผู้ก่อการร้ายที่ต้องสงสัยถูกส่งตัวไปปฏิบัติภารกิจฆ่าตัวตายที่ใจกลางเมืองที่มีประชากรหนาแน่น หากเขาทิ้งระเบิดหลายร้อยคนอาจตายหรือบาดเจ็บสาหัส ขั้นตอนการสแกนใบหน้าเป็นฝูงโดยใช้กล้องวงจรปิดช่วยให้คุณสามารถระบุผู้โจมตีและเปรียบเทียบคุณสมบัติของเขากับภาพถ่ายในฐานข้อมูลของผู้ก่อการร้ายชื่อดังหรือ "บุคคลที่น่าสนใจ" กับบริการรักษาความปลอดภัยโดยอัตโนมัติ

ในกรณีที่เกิดเหตุบังเอิญระบบจะส่งสัญญาณเตือนภัยและกองกำลังต่อต้านการก่อการร้ายของการตอบโต้อย่างรวดเร็วจะถูกส่งไปยังสถานที่ที่พวกเขา "ต่อต้าน" ผู้ต้องสงสัยก่อนที่เขาจะสามารถเปิดใช้งานวัตถุระเบิด ช่วยชีวิตหลายร้อยคนด้วยเทคโนโลยีที่ทันสมัย

ปัญหาที่เป็นไปได้ในที่ทำงาน

แต่ถ้าหากเทคโนโลยีการจดจำใบหน้า (FR) ไม่ทำงานอย่างถูกต้อง และมันกลับกลายเป็นว่าไม่ใช่ผู้ก่อการร้าย แต่เป็นคนธรรมดาที่โชคร้ายและเขากลายเป็นเหมือนผู้โจมตี ชีวิตผู้บริสุทธิ์จะถูกทำลายเพียงเพราะผู้เชี่ยวชาญเชื่อในระบบที่ผิดพลาดเช่นกัน แต่ถ้าคุณกลายเป็นคนแบบนี้ล่ะ?

นี่เป็นเพียงหนึ่งในประเด็นขัดแย้งทางจริยธรรมที่เผชิญหน้ากับระบบจดจำใบหน้าและปัญญาประดิษฐ์ เป็นการยากที่จะฝึกฝนเครื่องจักรให้“ มองเห็น” จดจำและแยกแยะวัตถุและใบหน้า การใช้คอมพิวเตอร์วิชั่นซึ่งบางครั้งเรียกว่าเมื่อไม่นานมานี้นักวิจัยพยายามที่จะกำหนดความแตกต่างระหว่างขนมปังกับลูกเกดและชิวาวาซึ่งกลายเป็นการทดสอบสารสีน้ำเงินสำหรับการตรวจสอบประสิทธิภาพของเทคโนโลยีนี้

ปัญหาการจดจำใบหน้า

นักเทคโนโลยีคอมพิวเตอร์ Joy Buolamvini ซึ่งเป็นตัวแทนของห้องปฏิบัติการที่ Massachusetts Institute of Technology (และในเวลาเดียวกันผู้ก่อตั้ง Algorithmic Justice League) และ Timnit Gebru ผู้ร่วมอำนวยการด้านเทคนิคของทีม Google ในเรื่องจริยธรรมที่เกี่ยวข้องกับปัญญาประดิษฐ์แสดงว่าระบบการจดจำใบหน้านั้นยาก แยกความแตกต่างระหว่างชายและหญิงหากผิวของพวกเขามืดพอ ระบบมักจะเข้าใจผิดว่าผู้หญิงที่มีผิวสีเข้มสำหรับผู้ชาย

“ ประมาณ 130 ล้านคนอเมริกันผู้ใหญ่อยู่ในฐานข้อมูลการจดจำใบหน้าแล้ว” ดร. เกเบรกล่าวในเดือนพฤษภาคมที่ AI เพื่อการประชุมสุดยอดที่ดีในเจนีวา “ แต่ชุดข้อมูลดั้งเดิมนั้นส่วนใหญ่จะเป็นตัวแทนของเผ่าพันธุ์สีขาวในหมู่คนที่มีผู้ชายมากกว่านี้” ดังนั้นเมื่อรู้จักคนที่มีสภาพผิวคล้ำจะยังคงมีข้อผิดพลาดเป็นจำนวนมากเนื่องจากประเภทของผิวและเพศ

การใช้เทคโนโลยี

เมื่อไม่นานมานี้เมืองซานฟรานซิสโกของรัฐแคลิฟอร์เนียได้ห้ามการใช้การจดจำใบหน้าโดยหน่วยงานด้านการขนส่งและการบังคับใช้กฎหมายในการรับรู้ถึงความไม่สมบูรณ์และภัยคุกคามต่อเสรีภาพของพลเมือง แต่เมืองอื่น ๆ ในสหรัฐอเมริกาและประเทศอื่น ๆ ของโลกยังคงได้สัมผัสกับเทคโนโลยีนี้

ยกตัวอย่างเช่นในสหราชอาณาจักรกองกำลังตำรวจในเซาธ์เวลส์ลอนดอนแมนเชสเตอร์และเลสเตอร์กำลังทดสอบเทคโนโลยีนี้ซึ่งทำให้องค์กรด้านเสรีภาพพลเรือนที่น่ากลัวอย่างเช่น Liberty และ Big Brother Watch ซึ่งมีความกังวลเกี่ยวกับจำนวนการจับคู่เท็จที่เกิดขึ้นเมื่อระบบทำงาน

ข้อผิดพลาดและความกลัว

ในทางปฏิบัติหมายความว่าผู้บริสุทธิ์เรียกว่าอาชญากรที่อาจเกิดขึ้น ตามที่ดร. Gebru ปัญหาดังกล่าวควรทำให้เกิดความกังวลสำหรับทุกคนการใช้มาตรการป้องกันและการทำนายดังกล่าวเกี่ยวข้องกับอัตราที่สูง

ระบุว่าคนอเมริกันผิวดำคิดเป็น 37.5% ของผู้ต้องขังเรือนจำทั้งหมดในสหรัฐ (อ้างอิงจากสำนักงานเรือนจำกลาง) แม้ว่าพวกเขาคิดเป็นเพียง 13% ของประชากรสหรัฐ แต่อัลกอริธึมที่เขียนไม่ดีโดยใช้ชุดข้อมูลที่มีอยู่ในปัจจุบันสามารถทำนายได้ คนผิวดำมีแนวโน้มที่จะก่ออาชญากรรมมากกว่า คุณไม่จำเป็นต้องเป็นอัจฉริยะเพื่อทำความเข้าใจว่านี่หมายถึงอะไรสำหรับตำรวจและนโยบายสังคม

อีกไม่นานนักวิทยาศาสตร์จาก University of Essex ได้ข้อสรุปว่าบังเอิญที่ใช้ในการทดลองในตำรวจลอนดอนผิด 80% ซึ่งอาจนำไปสู่การละเมิดความยุติธรรมและการละเมิดสิทธิความเป็นส่วนตัวของประชาชนอย่างร้ายแรง

เอ็ดบริดเจสชาวอังกฤษคนหนึ่งได้เริ่มดำเนินคดีกับการใช้เทคโนโลยีจดจำใบหน้าโดยตำรวจเซาธ์เวลส์หลังจากนั้น รูปถ่ายของเขาถูกจับในขณะที่เขากำลังช็อปปิ้งและผู้บัญชาการตำรวจอังกฤษด้านข้อมูล Elizabeth Denham แสดงความกังวลเกี่ยวกับการขาดกรอบทางกฎหมายที่ควบคุมการใช้เทคโนโลยีการจดจำ

แต่ความกลัวดังกล่าวไม่ได้หยุดยั้งอเมซอนยักษ์ใหญ่ด้านเทคโนโลยีจากการขายเครื่องมือ Rekognition FR ของตนให้กับกองกำลังตำรวจของสหรัฐอเมริกาแม้ว่าผู้ถือหุ้นจะไม่พอใจก็ตาม

กลุ่มเป้าหมาย

Amazon บอกว่ามันไม่รับผิดชอบต่อวิธีที่ลูกค้าใช้เทคโนโลยีของตน แต่เปรียบเทียบความสัมพันธ์นี้กับ Salesforce ซึ่งเป็นเทคโนโลยีสำหรับการจัดการความสัมพันธ์กับลูกค้าซึ่งได้พัฒนาเครื่องมือจดจำภาพของตัวเองที่เรียกว่า Einstein Vision

“ เทคโนโลยีการจดจำใบหน้าอาจจะเหมาะสมในคุกเพื่อติดตามนักโทษหรือป้องกันความรุนแรงของแก๊งค์” BBC Salesforce ผู้เชี่ยวชาญด้านปัญญาประดิษฐ์ด้านจริยธรรมของ BBC กล่าว แต่เมื่อตำรวจต้องการใช้งานร่วมกับกล้องเมื่อจับกุมผู้คน บริษัท พบว่าไม่เหมาะสม ในกรณีนี้เราควรถามว่าจำเป็นต้องใช้ AI โดยทั่วไปในบางสถานการณ์หรือไม่และหนึ่งในตัวอย่างคือการจดจำใบหน้า

ในปัจจุบันเทคโนโลยีนี้ยังถูกใช้โดยกองทัพเนื่องจากผู้ให้บริการเทคโนโลยีอ้างว่าซอฟต์แวร์ของพวกเขาไม่เพียง แต่สามารถระบุศัตรูที่อาจเกิดขึ้น แต่ยังรับรู้ถึงพฤติกรรมที่น่าสงสัย