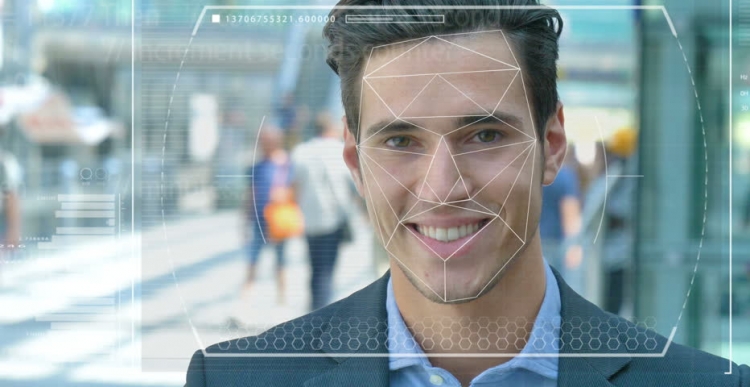

Visame pasaulyje policija ir saugumo pajėgos išbando automatines veido atpažinimo sistemas, kad galėtų jas naudoti kaip įrankį nusikaltėliams ir teroristams nustatyti. Tačiau ar ši technologija yra tiksli ir ar lengvai naudojama, o dirbtinis intelektas (AI), kurio pagrindu ji veikia, tampa persekiojimo ir priespaudos įrankiu?

Sistemos ypatybės

Įsivaizduokite, kad įtariamas teroristas siunčiamas į savižudybės misiją į tankiai apgyvendintą miesto centrą. Jei jis numeta bombą, šimtai žmonių gali mirti arba būti sunkiai sužeisti. Minios veidų skenavimo procedūra naudojant vaizdo stebėjimą leidžia atpažinti užpuoliką ir automatiškai palygina jo charakteristikas su nuotraukomis garsių teroristų ar „dominančių asmenų“ duomenų bazėje su saugumo tarnybomis.

Atsitiktinai sistema pavojaus signalą pakelia, o greitojo reagavimo antiteroristinės pajėgos siunčiamos į vietą, kur „neutralizuoja“ įtariamąjį, kol jis gali suaktyvinti sprogmenis. Dėl šiuolaikinių technologijų išgelbėta šimtai gyvybių.

Galimos problemos darbe

O kas, jei veido atpažinimo (FR) technologija neveikė tinkamai? Ir paaiškėjo, kad tai nėra teroristas, o paprastas žmogus, kuriam tiesiog nepasisekė ir jis pasirodė kaip užpuolikas. Nekaltas gyvenimas būtų buvęs tiesiog sunaikintas, nes ekspertai taip pat tikėjo klaidinga sistema. O kas, jei paaiškės, kad esi toks žmogus?

Tai tik viena iš etinių dilemų, susiduriančių su veido atpažinimo sistema ir dirbtiniu intelektu. Iš tiesų sunku mokyti mašinas „pamatyti“, atpažinti ir atskirti daiktus ir veidus. Naudodamiesi kompiuteriniu matymu, kaip jis kartais vadinamas, ne taip seniai, tyrėjai bandė nustatyti skirtumą tarp bandelių su razinomis ir čihuahua - tai tapo savotišku lakmuso testu nustatant šios technologijos efektyvumą.

Veido atpažinimo sunkumai

Kompiuterių technologai Joy Buolamvini, atstovaujantys laboratorijai Masačusetso technologijos institute (ir tuo pačiu Algorithmic Justice League įkūrėjas), ir Timnit Gebru, „Google“ komandos techninis direktorius dirbtinio intelekto etikos klausimais, parodė, kad veido atpažinimo sistema yra sudėtinga. išskiria vyrus ir moteris, jei jų oda yra pakankamai tamsi. Sistema gana dažnai klaidina moteris su tamsia oda vyrams.

„Apie 130 milijonų suaugusių amerikiečių jau naudojasi veido atpažinimo duomenų bazėmis“, - sakė dr. Gebru gegužę AI for Good viršūnių susitikime Ženevoje. „Tačiau pirminiuose duomenų rinkiniuose daugiausia yra baltųjų rasės atstovų, tarp kurių yra daug daugiau vyrų.“ Todėl, atpažįstant žmones su tamsesniu odos tipu, vis tiek yra didžiulis klaidų procentas dėl odos tipo ir lyties.

Technologijų naudojimas

Kalifornijos mieste San Fransiske neseniai buvo uždrausta naudoti veido atpažinimą transporto ir teisėsaugos agentūroms, pripažįstant jos trūkumus ir grėsmę pilietinėms laisvėms. Tačiau kiti JAV ir kitų pasaulio šalių miestai ir toliau patiria šią technologiją.

Pavyzdžiui, Jungtinėje Karalystėje Pietų Velso, Londono, Mančesterio ir Lesterio policijos pajėgos išbando šią technologiją, kuri baugina tokias pilietinių laisvių organizacijas kaip „Liberty“ ir „Big Brother Watch“, susirūpinusi dėl melagingų atitikmenų, įvykusių veikiant sistemai, skaičiaus.

Klaidos ir baimės

Praktiškai tai reiškia, kad nekalti žmonės klaidingai vadinami potencialiais nusikaltėliais. Pasak dr. Gebru, tokios problemos tikrai turėtų kelti susirūpinimą kiekvienam, tokių prevencinių ir numatančių priemonių taikymas susijęs su dideliais tarifais.

Atsižvelgiant į tai, kad juodaodžiai amerikiečiai sudaro 37,5% visų kalinių, esančių JAV (Federalinio kalėjimų biuro duomenimis), nepaisant to, kad jie sudaro tik 13% JAV gyventojų, prastai surašyti algoritmai, naudojantys šiuo metu turimus duomenų rinkinius, gali numatyti kad juodaodžiai labiau linkę į nusikaltimą. Nereikia būti genijumi, kad suprastum, ką tai gali reikšti policijai ir socialinei politikai.

Visai neseniai Esekso universiteto mokslininkai padarė išvadą, kad sutapimai, kurie buvo naudojami teismo procesuose Londono policijoje, buvo 80% klaidingi, o tai gali sukelti rimtų teisingumo pažeidimų ir piliečių teisės į privatumą pažeidimą.

Po to vienas britas Edas Bridgesas pradėjo teismo procesą dėl veido atpažinimo technologijos naudojimo Pietų Velso policijoje jo nuotrauka daryta apsipirkinėjant, o britų informacijos komisarė Elizabeth Denham išreiškė susirūpinimą dėl teisinės sistemos, reglamentuojančios atpažinimo technologijos naudojimą, trūkumo.

Tačiau tokios baimės nesutrukdė technikos milžinei „Amazon“ parduoti savo įrankį „Rekognition FR“ JAV policijos pajėgoms, nepaisant akivaizdžių akcininkų riaušių, kurios vis tiek nulėmė nieko.

Perspektyvos

„Amazon“ sako, kad nėra atsakinga už tai, kaip klientai naudojasi jos technologijomis. Bet palyginkite šiuos santykius su „Salesforce“ - ryšių su klientais valdymo technologija, sukūrusia savo įvaizdžio atpažinimo įrankį pavadinimu „Einstein Vision“.

„Veido atpažinimo technologija gali būti tinkama kalėjime, siekiant sekti kalinius ar užkirsti kelią gaujų smurtui“, - teigė BBC etinio dirbtinio intelekto ekspertas „BBC Salesforce“. Tačiau kai areštuodama žmones policija norėjo tai naudoti kartu su kameromis, bendrovė nustatė, kad tai netinkama. Tokiu atveju reikėtų paklausti, ar tam tikruose scenarijuose apskritai reikia naudoti AI, o vienas iš pavyzdžių yra veido atpažinimas.

Šiuo metu šią technologiją naudoja ir kariškiai, nes technologijų tiekėjai tvirtina, kad jų programinė įranga gali ne tik atpažinti galimus priešus, bet ir atpažinti įtartiną elgesį.